Sprachmodelle wie ChatGPT oder Claude haben eine Eigenschaft, die gerne übersehen wird: Sie arbeiten mit einem begrenzten Kontextfenster. Alles, was in einem Chat besprochen wird, jedes Dokument, jede Anweisung, muss in dieses Fenster passen. Bei den meisten Modellen sind das heute einige hunderttausend Tokens, bei manchen bis zu einer Million. Klingt nach viel, ist es aber nicht, wenn man an das gesammelte Wissen eines Unternehmens denkt: Verträge, Protokolle, Handbücher, Organigramme, E-Mails. Da kommt man schnell auf Millionen von Seiten. Einfach alles in den Chat kippen funktioniert nicht, und selbst wenn es technisch ginge, wäre es unbezahlbar, weil jeder Token Rechenzeit kostet.

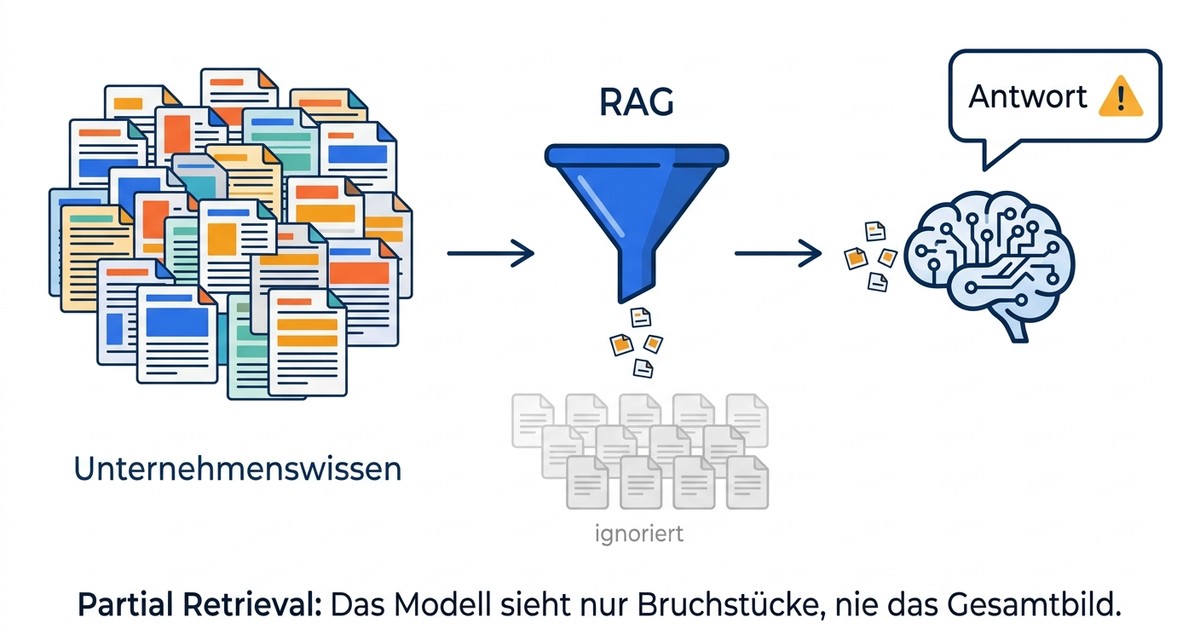

Retrieval-Augmented Generation, kurz RAG, galt als die elegante Lösung für genau dieses Problem. Statt dem Modell alles auf einmal zu geben, sucht ein vorgeschaltetes System bei jeder Frage die vermeintlich relevanten Dokumente heraus und schiebt nur diese in den Kontext. In vielen Unternehmen wurde das begeistert aufgenommen.

Ich wollte es genau wissen und habe mit meinem Team einen konkreten Test aufgesetzt: Wir haben über LangChain einen RAG-Prototyp gebaut und ihn auf unsere internen Unternehmensdokumente losgelassen. Der Testfall war bewusst anspruchsvoll: Wir haben Fragen zu sich verändernden Organisationsstrukturen gestellt, also Fragen, bei denen das System alte und neue Zuständigkeiten auseinanderhalten muss. Das Ergebnis war ernüchternd. Das System hat Abteilungen verwechselt, veraltete Strukturen mit aktuellen vermischt und Zuständigkeiten erfunden, die es nie gab. Genau die Art von Fehler, die in einem Unternehmen nicht passieren darf.

Partial Retrieval statt Verstehen

Was war passiert? RAG funktioniert so: Es zerlegt Dokumente in Fragmente, sogenannte Chunks, und sucht bei jeder Frage die Bruchstücke heraus, die semantisch am besten passen. Diese Handvoll Fragmente wird dem Sprachmodell als Kontext übergeben. Alles, was nicht in diesem Ausschnitt landet, existiert für das Modell nicht. Kein zweiter Blick, kein „Moment, da war doch noch etwas“.

Man kann sich das vorstellen wie eine Google-Suche: Man bekommt die fünf relevantesten Treffer, aber eben nur fünf. Nicht die Gesamtheit des Wissens, nicht die Zusammenhänge zwischen den Dokumenten, sondern einzelne Bruchstücke. Inzwischen gibt es dafür einen ehrlicheren Namen: Partial Retrieval. Und der trifft es genau.

In unserem Test mit den Organisationsstrukturen war genau das das Problem: Das System hat Chunks aus Dokumenten verschiedener Jahrgänge zusammengewürfelt, ohne zu erkennen, dass ein Organigramm von 2022 nicht mit einem von 2024 kombiniert werden kann. Es fehlte der Gesamtkontext, und ohne den wird jede Antwort zum Ratespiel.

Google AI Overviews: Partial Retrieval in Aktion

Wer das für ein obskures Technikproblem hält, muss nur ab und zu auf Googles AI Overviews achten. Diese KI-Zusammenfassungen über den Suchergebnissen arbeiten nach einem ähnlichen Prinzip. Und hin und wieder passiert genau das: Aussagen aus drei verschiedenen Websites werden zu einer Antwort verrührt, die schlüssig klingt, aber faktisch nicht stimmt. Jede einzelne Quelle war für sich korrekt. Zusammengewürfelt wird Falsches draus.

Bei Google ist das ärgerlich. In einem Unternehmen, bei Compliance-Fragen oder strategischen Entscheidungen, kann es richtig teuer werden.

Warum echtes Verstehen vollen Kontext braucht

Wenn ich mich in ein Thema einarbeite, lese ich nicht fünf zufällige Absätze. Ich lese das ganze Dokument. Ich erkenne Zusammenhänge, gewichte Widersprüche. RAG macht das Gegenteil: Es greift sich Fragmente nach semantischer Nähe heraus und hat keine Ahnung, was links und rechts davon steht. Dass so wenige Leute diesen Punkt ansprechen, irritiert mich.

Fazit

RAG ist kein schlechtes Werkzeug, solange man versteht, was es ist: eine Suchmaschine mit KI-Oberfläche, nicht ein LLM mit dem gesamten Firmenwissen. Wer RAG für einfache Nachschlagefragen einsetzt, für klar abgegrenzte Datenbestände, der wird brauchbare Ergebnisse bekommen. Aber wer glaubt, damit ein KI-Gedächtnis zu haben, das alle Zusammenhänge im Unternehmen versteht, wird früher oder später auf genau die Probleme stoßen, die wir in unserem Test gesehen haben. Ob erweiterte Kontextfenster oder neue Wissensarchitekturen daran etwas ändern, wird sich zeigen. Bis dahin sollten wir Partial Retrieval beim Namen nennen und aufhören, es für mehr zu halten.